摘要 :

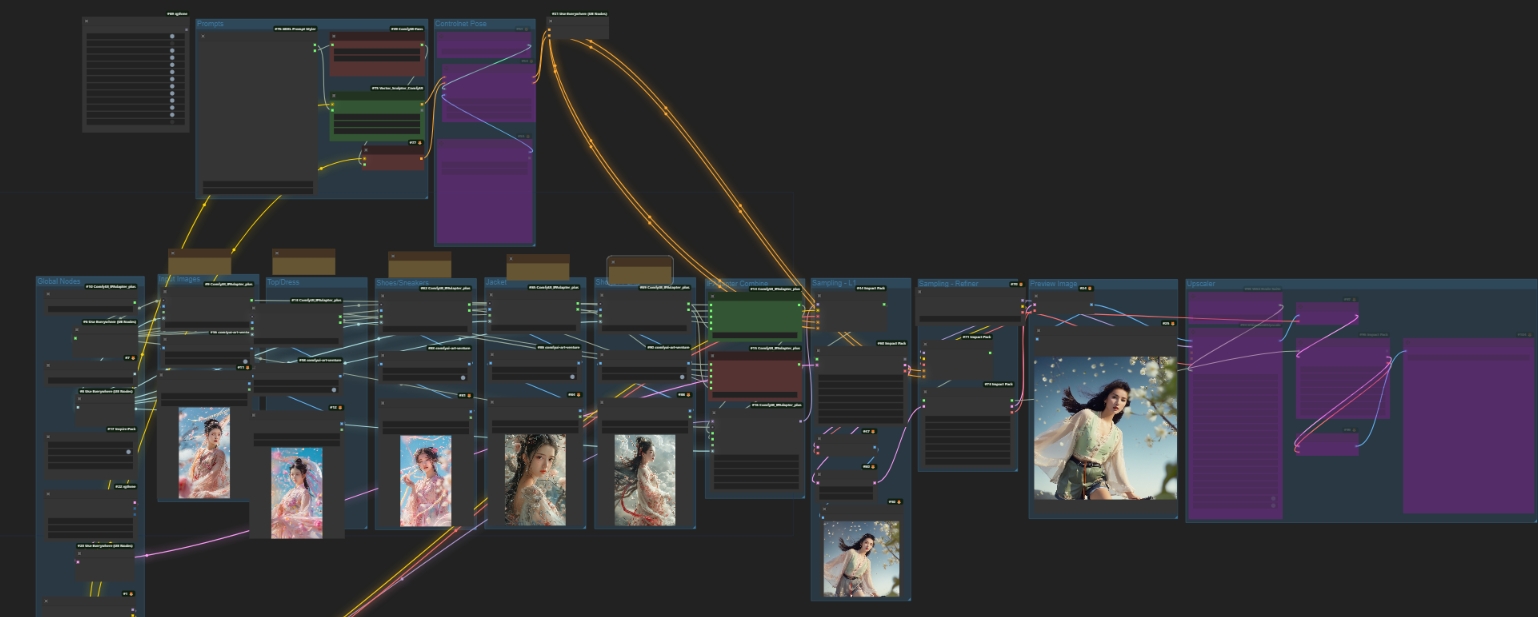

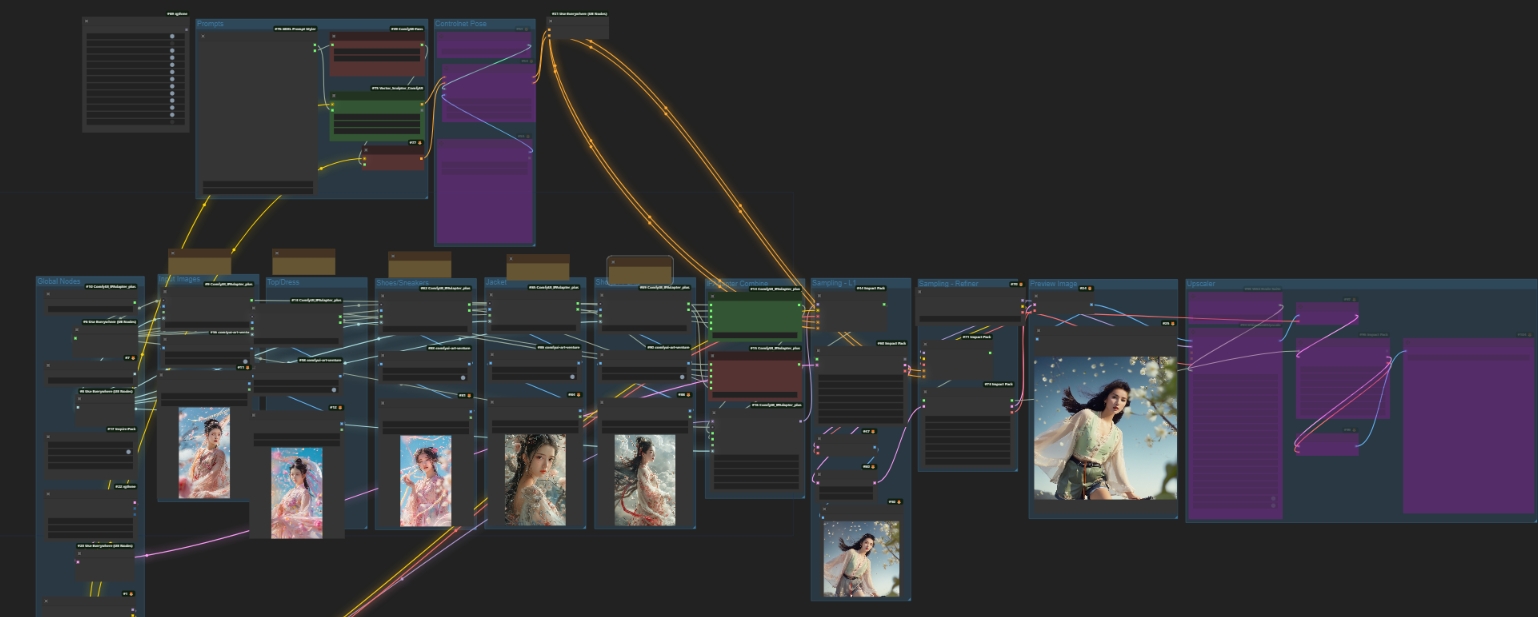

ComfyUI 全身换工作流主要是对已有图像中的人物全身进行替换或修改,使其呈现出不同的姿态、服饰、风格等,以下为你详细介绍:

准备工作

模型准备:准备合适的基础模型……

ComfyUI 全身换工作流主要是对已有图像中的人物全身进行替换或修改,使其呈现出不同的姿态、服饰、风格等,以下为你详细介绍:

- 模型准备:准备合适的基础模型,如 StableDiffusion 系列中擅长人物生成的模型,如 Anything V3 等;同时准备 ControlNet 相关模型,如 OpenPose 用于姿态控制、IP – Adapter 用于风格和特征控制。

- 参考素材:收集好想要替换的全身姿态参考图、风格参考图等。

- 图像加载:使用 “Load Image” 节点加载原始图像,即包含需要替换全身的图像。

- 模型加载:通过 “Checkpoint Loader” 加载基础模型,利用 “ControlNet Loader” 加载相应的 ControlNet 模型。

- 姿态估计:若有全身姿态参考图,使用 OpenPose 预处理器节点对其进行处理,提取姿态信息。将姿态参考图连接到 OpenPose 节点,该节点会输出姿态骨骼图。

- 连接 ControlNet:将姿态骨骼图连接到 ControlNet 节点,再把 ControlNet 节点连接到 “K Sampler”,以此控制生成图像的人物姿态。

- 正向提示词:在 “CLIP Text Encode” 节点输入正向提示词,描述想要替换后的全身特征,如 “穿着古风汉服,优雅站立的少女”“肌肉发达、穿着运动装跑步的男性” 等。

- 反向提示词:输入反向提示词排除不想要的元素,如 “模糊的人物”“奇怪的比例” 等。

- IP – Adapter 应用:若有特定风格或特征参考图,可使用 IP – Adapter。将参考图通过相应节点处理后,连接到 IP – Adapter 节点,再连接到 “K Sampler”,以控制生成人物的风格和特征,如发型、面部特征等。

- 参数设置:在 “K Sampler” 节点设置采样器类型(如 DPM++ 2M Karras)、采样步数(通常 20 – 50 步)、CFG Scale(控制提示词影响程度,一般 7 – 12)等参数。

- 生成图像:点击 “Queue Prompt” 开始生成图像,模型会根据输入的各种信息生成全身替换后的图像。

- 图像优化:使用 “Image Adjust” 节点调整图像的色彩、对比度、亮度等,使图像效果更好。

- 瑕疵修复:若生成图像存在瑕疵,可使用图像修复工具或再次局部重绘进行修正。

还没有评论呢,快来抢沙发~