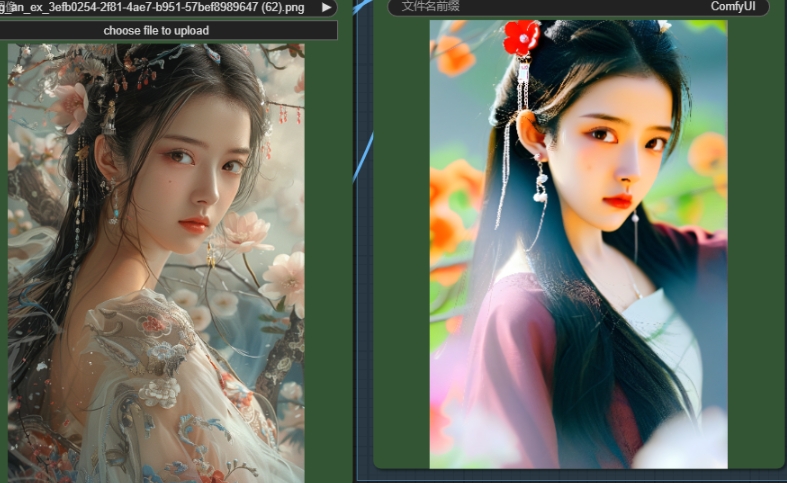

摘要 :

ComfyUI 图片转绘是利用其节点式操作界面,结合各类 AI 模型将已有图片转换为具有不同风格、内容或表现形式的新图片的过程。以下为你详细介绍其工作流程、关键要素及应……

ComfyUI 图片转绘是利用其节点式操作界面,结合各类 AI 模型将已有图片转换为具有不同风格、内容或表现形式的新图片的过程。以下为你详细介绍其工作流程、关键要素及应用场景。

- 模型加载:

- 使用 “Checkpoint Loader” 节点加载基础的图像生成模型,例如 Stable Diffusion 系列模型,不同版本的模型在生成风格和质量上存在差异,可按需选择。

- 若要借助特定控制信息进行转绘,还需通过 “ControlNet Loader” 加载相应的 ControlNet 模型,如 Canny 边缘检测模型、深度模型等。

- 图片导入:运用 “Load Image” 节点从本地导入待转绘的图片。

将导入的图片连接到 “VAE Encode” 节点,把图片转换为潜在空间表示,便于后续模型处理。

- 正向提示词:在 “CLIP Text Encode” 节点输入正向提示词,详细描述期望转绘后的图片特征,涵盖风格(如 “动漫风格”“写实油画风格”)、主题(如 “森林中的精灵”“繁华都市夜景”)、色彩(如 “暖色调”“冷色调”)等方面。例如:“动漫风格,可爱的小精灵在森林中嬉戏,暖色调”。

- 反向提示词:同样在该节点输入反向提示词,排除不想要的元素,像 “模糊的画面”“奇怪的颜色搭配” 等,提升生成图片的质量。

若使用 ControlNet 辅助转绘,需进行以下操作:

- 生成控制信息:将原始图片连接到对应 ControlNet 模型的预处理器节点,生成相应的控制信息。例如,使用 Canny 边缘检测预处理器生成图片的边缘信息。

- 连接与参数设置:把生成的控制信息连接到 “ControlNet” 节点,再将 “ControlNet” 节点连接到 “K Sampler” 节点。在 “ControlNet” 节点设置参数,如 “Control Weight”(控制控制信息对生成结果的影响程度)、“Start Step” 和 “End Step”(控制在采样过程中应用控制信息的阶段)。

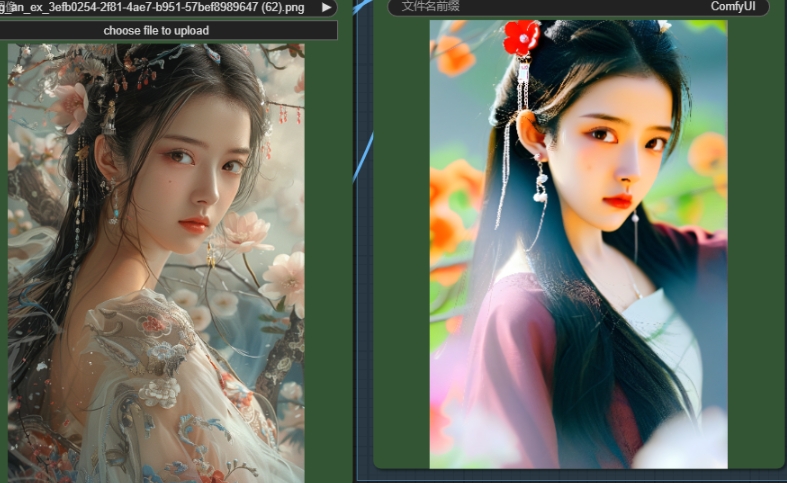

在 “K Sampler” 节点设置采样参数,如采样器类型(如 DPM++ 2M Karras)、采样步数(通常 20 – 50 步)、CFG Scale(控制提示词对生成结果的影响程度,一般取值 7 – 12)等。设置完成后,点击 “Queue Prompt” 开始生成图片,通过 “VAE Decode” 节点得到转绘后的图片。

若生成的图片未达预期,可调整提示词、ControlNet 参数或采样参数,再次生成。还能利用 ComfyUI 中的其他节点对图片进行后期处理,如调整色彩、对比度等。

提示词越具体明确,生成的图片越符合期望。可参考优秀的提示词示例,学习表述方式和技巧。

合理选择和配置 ControlNet 模型能显著提升转绘效果,使生成的图片更好地保留原始图片的特定特征,如边缘、深度等。

不同的图片和需求需要不同的参数设置,需不断尝试和调整,以获取最佳效果。

将现实照片转换为动漫、油画、水彩等艺术风格,增添艺术氛围。

在保留原始图片部分元素的基础上,修改其他内容,如改变背景、添加或删除物体等。

结合创意提示词和 ControlNet,生成独特的创意图片,用于广告设计、插画创作等领域。

还没有评论呢,快来抢沙发~